从本地部署一个Deepseek R1深度学习模型(Windows)

1. 配置要求

具体配置依情况而定,16G 内存勉强可以带动 14b 模型。

(更详细的配置参考 Linux 那篇文章。)

2. 下载 Ollama

Windows 端可以使用 Ollama,下载 Windows 版本并安装。

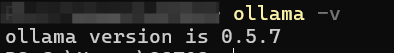

安装完成后,在终端中输入:

1 | ollama -v |

如果回显 Ollama 版本号,就说明安装成功。

3. 下载模型

在 Ollama 官网选择 Models,找到 deepseek-r1。

根据自己电脑配置选择模型版本。比如 4b 代表 40 亿参数,参数越大效果通常越好,但对硬件要求也更高。

我的电脑是 2×16G 双通道内存,所以选择 14b,执行:

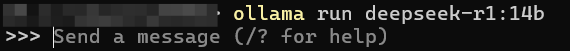

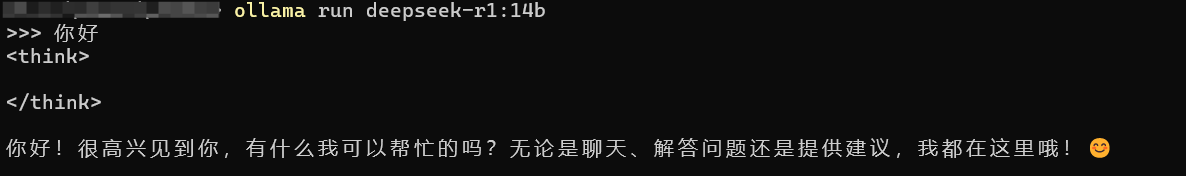

1 | ollama run deepseek-r1:14b |

等待下载完成后即可开始对话。

后续再次启动模型时,仍然执行同一条命令:

1 | ollama run deepseek-r1:14b |

4. 换个 UI

如果不想只在终端里使用,可以配一个更直观的图形界面,例如 Chatbox。

安装后选择你已经下载的 deepseek-r1:14b 模型即可使用。

5. 测试能力(测试模型:deepseek-r1:14b)

5.1 断网测试

离线状态下也可以使用,能生成一些简单代码,但响应速度会偏慢。

5.2 文件交互

终端交互方式无法直接读取本地文件、音频等内容。

如果有文件交互需求,可以使用 Chatbox 等图形界面工具。

本博客所有文章除特别声明外,均采用 CC BY-NC-SA 4.0 许可协议。转载请注明来源 F1fk3r's Blog!

评论